大模型研發新范式 數據工程、自動化評估與知識圖譜的融合創新

隨著人工智能技術的飛速發展,大模型已成為推動行業變革的核心引擎。其研發不再局限于單一的算法優化,而是演變為一項涉及數據工程、自動化評估、知識圖譜融合及軟硬件協同的系統性工程。這一技術動態正深刻重塑著人工智能的研發范式與產業生態。

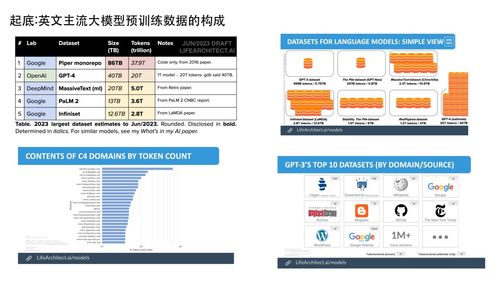

一、數據工程:大模型研發的基石

數據質量與規模直接決定了大模型性能的上限。現代大模型研發將數據工程置于核心位置,涵蓋高質量數據采集、清洗、標注、增強及隱私脫敏等全流程。通過構建系統化的數據流水線(Data Pipeline),研發團隊能夠持續供應大規模、多樣化、符合倫理規范的高價值數據集,為大模型訓練提供堅實的“燃料”基礎。合成數據生成、多模態數據對齊等技術,正有效緩解數據稀缺與偏見問題,推動模型向更公平、更魯棒的方向演進。

二、自動化評估:驅動模型迭代的閉環

傳統依賴人工的模型評估方法,已無法滿足大模型快速迭代的需求。自動化評估體系通過構建多維度的基準測試集(如常識推理、代碼生成、安全對齊等),結合自動化評分、紅隊測試(Red Teaming)和持續監控,實現了對模型性能、安全性、可靠性的高效量化評估。這一閉環不僅加速了研發周期,更能及時識別模型缺陷(如幻覺、偏見),確保其在部署前達到預期的質量標準。自動化評估正成為大模型研發中不可或缺的“質檢系統”。

三、與知識圖譜的結合:注入結構化知識,提升認知能力

大模型雖擁有強大的模式識別與生成能力,但在事實準確性、邏輯推理及可解釋性上仍面臨挑戰。與知識圖譜的結合為這一難題提供了關鍵路徑。通過將知識圖譜中的結構化、關聯性知識(如實體、關系、屬性)注入大模型的訓練或推理過程,可以有效增強模型的事實記憶、因果推理和知識追溯能力。這種“神經+符號”的融合,不僅提升了模型輸出的準確性與可信度,也為構建可解釋、可更新的下一代認知智能系統奠定了基礎。

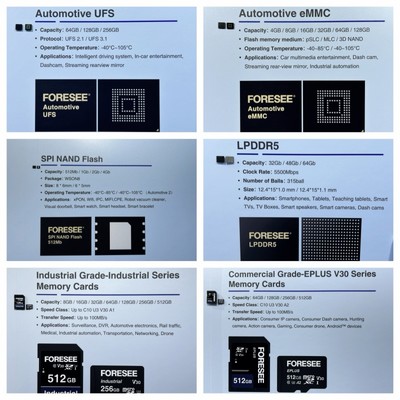

四、計算機軟硬件開發及銷售:支撐研發與落地的產業基石

大模型的訓練與部署對算力提出了前所未有的要求。這驅動了計算機軟硬件的協同創新:在硬件層面,專用AI芯片(如GPU、TPU)、高速互聯技術與綠色數據中心,為大規模分布式訓練提供了強大算力支撐;在軟件層面,高效的深度學習框架、模型壓縮與推理優化工具鏈,正努力降低大模型的部署與運行成本。圍繞大模型研發、訓練、部署、服務的軟硬件一體化解決方案,已成為新興的市場增長點,從芯片、服務器到云服務平臺,完整的產業鏈正在加速形成,推動技術成果向實際應用的高效轉化。

###

大模型的研發已進入一個以數據為驅動、評估為導向、知識為增強、軟硬件為支撐的深度融合新階段。數據工程、自動化評估與知識圖譜的結合,構成了提升模型能力與可靠性的核心三角。而底層軟硬件的持續創新,則為這一切提供了可行的工程基礎與商業化通道。這一動態的技術生態將繼續演化,推動人工智能在更廣領域實現更深層次的賦能與創新。

如若轉載,請注明出處:http://m.ypjkgl1.cn/product/58.html

更新時間:2026-04-02 23:58:25